Uvod u ansamblove tehnike

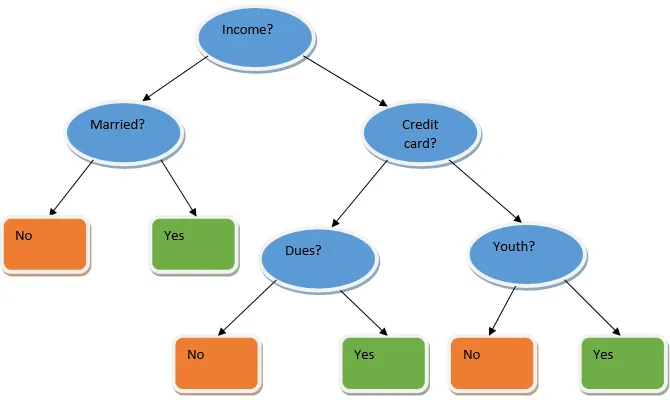

Ansamblsko učenje je tehnika strojnog učenja koja koristi nekoliko baznih modela i kombinira njihove rezultate kako bi proizvela optimizirani model. Ova vrsta algoritma strojnog učenja pomaže u poboljšanju ukupnih performansi modela. Ovdje je osnovni model koji se najčešće koristi je klasifikator stabla. Stablo odluka u osnovi djeluje na nekoliko pravila i daje prediktivni ishod, gdje su pravila čvorovi i njihova odluka će biti njihova djeca, a čvorovi listova će činiti konačnu odluku. Kao što je prikazano u primjeru stabla odluka.

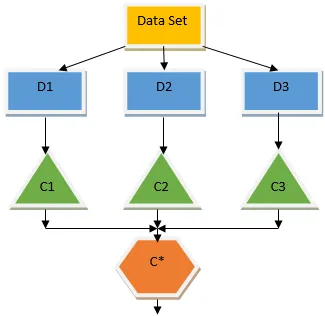

Gore navedeno stablo odluka u osnovi govori o tome može li osoba / kupac dobiti zajam ili ne. Jedno od pravila prihvatljivosti zajma je da ako (prihod = da i & oženjen = ne), tada zajam = da, tako funkcionira klasifikator stabla odluka. Ove klasifikatore ćemo ugraditi kao višestruki bazni model i kombinirati njihov izlaz za izgradnju jednog optimalnog prediktivnog modela. Na slici 1.b prikazana je ukupna slika algoritma učenja ansambla.

Vrste tehnika ansambla

Različiti tipovi sastava, ali naš glavni fokus bit će na sljedeće dvije vrste:

- Pakiranje

- Jačanje

Ove metode pomažu u smanjenju varijanci i pristranosti u modelu strojnog učenja. Pokušajmo sada razumjeti što je pristranost i odstupanje. Pristranost je pogreška koja nastaje zbog pogrešnih pretpostavki u našem algoritmu; visoka pristranost ukazuje na to da je naš model previše jednostavan / nedovoljan. Varijanca je greška koja nastaje zbog osjetljivosti modela na vrlo male fluktuacije u skupu podataka; velika varijanca ukazuje na to da je naš model vrlo složen / prenaporan. Idealan model ML trebao bi imati pravilan balans između pristranosti i odstupanja.

Agregiranje / podmetanje za dizanje

Torba je ansambl tehnika koja pomaže u smanjenju varijanci u našem modelu i na taj način izbjegava prekomjerno uklapanje. Torba je primjer algoritma paralelnog učenja. Torba djeluje na dva principa.

- Pokretanje sustava: Iz izvornog skupa podataka s obzirom na zamjenu razmatraju se različite populacije uzoraka.

- Objedinjavanje: Usrednjavanje rezultata svih klasifikatora i davanje pojedinačnog izlaza za to koristi glasovanje većinom u slučaju klasifikacije i prosjeka u slučaju problema s regresijom. Jedan od poznatih algoritama strojnog učenja koji upotrebljava koncept vreća je slučajna šuma.

Slučajna šuma

U nasumičnoj šumi iz nasumičnog uzorka koji je povučen iz populacije zamjenom i podskup značajki odabran je iz skupa svih značajki koje je izgrađeno stablo odluka. Iz tih podskupina značajki koja god značajka daje najbolje dijeljenje odabrana je kao korijen stabla odluke. Podskup značajki mora biti odabran nasumično po svaku cijenu, jer ćemo u suprotnom proizvesti samo korelirane trese i varijanca modela se neće poboljšati.

Sada smo izgradili naš model s uzorcima uzetim iz populacije, pitanje je kako validirati model? Budući da uzorke razmatramo zamjenom, stoga se svi uzorci neće uzeti u obzir, a neki od njih neće biti uključeni ni u jednu vrećicu, a oni se nazivaju izvan uzoraka vrećica. Možemo potvrditi naš model s ovim OOB (izvan vreće) uzoraka. Važni parametri koje treba uzeti u obzir u nasumičnoj šumi je broj uzoraka i broj stabala. Razmotrimo 'm' kao podskup značajki, a 'p' je cijeli skup značajki, a sada je kao pravilo s palcem uvijek idealno odabrati

- m as√ i minimalna veličina čvora kao 1 za problem s klasifikacijom.

- m kao P / 3 i minimalna veličina čvora da bude 5 za regresijski problem.

M i p treba tretirati kao parametre podešavanja kad se bavimo praktičnim problemom. Obuka se može prekinuti kad se pogreška OOB stabilizira. Jedan nedostatak slučajne šume je taj što kada u našem skupu podataka imamo 100 značajki i samo nekoliko značajki je važno da će ovaj algoritam raditi loše.

Jačanje

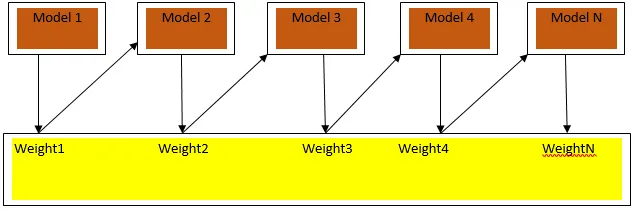

Pojačavanje je sekvencijalni algoritam učenja koji pomaže u smanjenju pristranosti u našem modelu i varijanci u nekim slučajevima nadziranog učenja. Također pomaže u pretvaranju slabih učenika u snažne učenike. Pojačavanje djeluje na principu postavljanja slabih učenika uzastopno i dodijeljuje težinu svakoj točki podataka nakon svakog kruga; veća težina se dodeljuje pogrešno razvrstanoj točki podataka u prethodnom krugu. Ova sekvencijalna ponderirana metoda treninga našeg skupa podataka ključna je razlika u načinu pakiranja.

Fig3.a prikazuje opći pristup poticanja

Konačna predviđanja kombiniraju se na temelju glasa ponderirane većine u slučaju klasifikacije i ponderirane svote u slučaju regresije. Najčešći algoritam poticanja pojačanja je adaptivno pojačavanje (Adaboost).

Prilagodljivo jačanje

Koraci uključeni u algoritam Adaboost su sljedeći:

- Za dane n podatkovne točke definiramo ciljanu klasu i inicijaliziramo sve težine na 1 / n.

- Podatke klasifikujemo u skup podataka i odabiremo klasifikaciju s najmanje ponderiranom greškom klasifikacije

- Utezi klasifikatora dodijelimo palčevim pravilom na temelju točnosti, ako je točnost veća od 50%, onda je težina pozitivna i obrnuto.

- Ažuriramo težine klasifikatora na kraju iteracije; ažuriramo više težine za pogrešno klasificiranu točku da bismo je u sljedećoj iteraciji ispravno klasificirali.

- Nakon svih ponavljanja dobivamo konačni rezultat predviđanja temeljen na većinskom glasačkom / ponderiranom prosjeku.

Adaboosting djeluje učinkovito sa slabim (manje složenim) polaznicima i s visokim klasifikatorima pristranosti. Glavne prednosti Adaboostinga su u tome što je brz, nema parametara podešavanja sličnih slučaju pakiranja i ne dajemo nikakve pretpostavke o slabim učenicima. Ova tehnika ne daje točan rezultat kada

- Prema našim podacima postoji više odmetnika.

- Skup podataka je nedovoljan.

- Slabi učenici vrlo su složeni.

Osjetljivi su i na buku. Stabla odluka koja se dobiju kao rezultat pojačanja imat će ograničenu dubinu i visoku točnost.

Zaključak

Ansamblne tehnike učenja široko se koriste u poboljšanju preciznosti modela; moramo odlučiti koju ćemo tehniku koristiti na temelju našeg skupa podataka. Ali ove se tehnike ne preferiraju u nekim slučajevima gdje je interpretacija važna, jer gubimo interpretabilnost po cijenu poboljšanja performansi. Oni imaju ogroman značaj u zdravstvenoj industriji gdje je malo poboljšanje performansi vrlo vrijedno.

Preporučeni članci

Ovo je vodič za Ansambl tehnike. Ovdje smo raspravljali o uvodu i dvije glavne vrste ansambl tehnike. Možete i proći kroz naše druge povezane članke da biste saznali više -

- Tehnike steganografije

- Tehnike strojnog učenja

- Tehnike team buildinga

- Algoritmi znanosti podataka

- Najčešće korištene tehnike ansamblovskog učenja