Uvod u metode strojnog učenja

Sljedeći članak, Metode strojnog učenja daje pregled najčešće korištenih metoda u strojnom učenju. Strojno učenje je tehnika koja omogućuje računalu da samostalno 'nauči' stvari. Algoritmi adaptivno poboljšavaju svoje performanse kako se povećavaju podaci dostupni za učenje. To je više podataka, točniji bi bio naš model.

Kako strojevi uče?

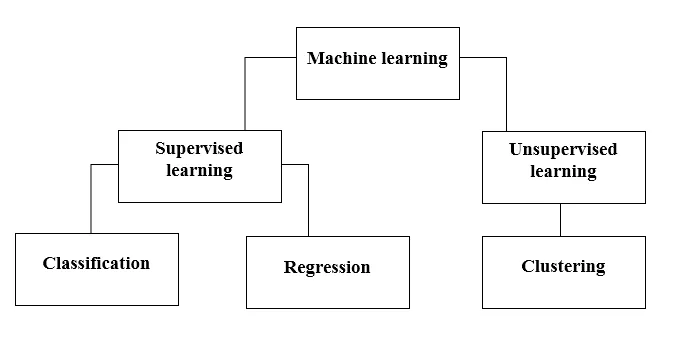

Postoje različite metode za to. Koju metodu u potpunosti slijediti ovisi o izjavi problema. Ovisno o skupu podataka i našem problemu, postoje dva različita načina za dublje napredovanje. Jedan je učenje pod nadzorom, a drugi učenje bez nadzora. Sljedeći grafikon objašnjava daljnju klasifikaciju metoda strojnog učenja. Raspravljat ćemo o njima jedan po jedan.

Pogledajte sljedeći grafikon!

Da razumemo što znači nadzirano učenje.

Nadzirano učenje

Kao što ime govori, zamislite učitelja ili supervizora koji će vam pomoći da učite. Isto vrijedi i za strojeve. Stroj treniramo ili podučavamo koristeći podatke koji su označeni.

Neke od najboljih aplikacija za učenje koje nadgledaju su:

- Analiza osjećaja (Twitter, Facebook, Netflix, YouTube, itd.)

- Obrada prirodnog jezika

- Klasifikacija slike

- Prediktivna analiza

- Prepoznavanje uzorka

- Otkrivanje neželjene pošte

- Obrada govora / slijeda

Sada se nadzirano učenje dalje dijeli na klasifikaciju i regresiju. Razumijemo ovo.

Klasifikacija

Klasifikacija je postupak pronalaska modela koji pomaže u odvajanju podataka u različite kategorijske klase. U ovom se procesu podaci kategoriziraju pod različitim naljepnicama prema nekim parametrima danim u ulazu, a zatim se naljepnice predviđaju za podatke. Kategorično znači da je izlazna varijabla kategorija, tj. Crvena ili crna, neželjena ili neželjena, dijabetička ili ne-dijabetička itd.

Modeli klasifikacije uključuju strojeve s vektorima podrške (SVM), K-najbližeg susjeda (KNN), Naive Bayes itd.

a) Strojni vektorski klasifikator (SVM)

SVM je nadzirana metoda učenja koja pregledava podatke i razvrstava ih u jednu od dvije kategorije. Koristim hiperplane za kategorizaciju podataka. Linearni diskriminativni klasifikator pokušava nacrtati ravnu liniju koja razdvaja dva skupa podataka i na taj način stvori model za klasifikaciju. Jednostavno pokušava pronaći liniju ili krivulju (u dvije dimenzije) ili razdjelnik (u više dimenzija) koji dijele klase jedna od druge.

Napomena - Za klasifikaciju u više klase SVM koristi 'jedan prema ostatku', to znači izračunavanje različitih SVM za svaku klasu.

b) K-najbliži klasifikator susjeda (KNN)

- Ako pažljivo pročitate, samo ime sugerira što algoritam radi. KNN smatra da su podatkovne točke koje su bliže, mnogo sličnije u značajkama, pa stoga vjerojatnije pripadaju istoj klasi kao i susjedi. Za svaku novu točku podataka izračunava se udaljenost do svih ostalih podatkovnih točaka i klasa se odlučuje na temelju K najbližih susjeda. Da, možda zvuči hromo, ali za neke klasifikacije djeluje kao išta.

- Točka podataka klasificira se prema maksimalnom broju glasova svojih susjeda, a zatim se podatkovna točka dodjeljuje najbližoj klasi među k-susjedima.

- U KNN-u nije potrebno učenje modela i svi se radovi događaju u vrijeme kada se traži predviđanje. Zbog toga se KNN često naziva algoritam lijenog učenja.

c) Naivni Bayesov klasifikator

- Naïve Bayes algoritam strojnog učenja koji se toplo preporučuje za probleme s klasifikacijom teksta. Temelji se na Bayesovoj teoremi vjerojatnosti. Te se klasifikatore naziva naivanima, jer pretpostavljaju da varijable značajki nisu međusobno neovisne. To znači, na primjer, da imamo cijelu rečenicu za unos, tada Naive Bayes pretpostavlja da je svaka riječ u rečenici neovisna od ostalih. I onda ih klasificirajte u skladu s tim. Znam da izgleda prilično naivno, ali je odličan izbor za probleme s klasifikacijom teksta i popularan je izbor za klasifikaciju neželjene e-pošte.

- Pruža različite vrste Naivnih Bayerovih algoritama poput BernoulliNB, GaussianNB, MultinomialNB.

- Smatra da su sve značajke nepovezane, pa ne može naučiti odnos između značajki. Na primjer, recimo, Varun voli jesti hamburgere, također voli jesti pomfrit s koksom. Ali on ne voli zajedno jesti hamburg, ali i kombinaciju pomfrit s koksom. Ovdje Naive Bayes ne može naučiti odnos između dva obilježja, već samo uči o važnosti pojedinca.

Prijeđite na drugu stranu nadziranog načina učenja, a to je regresija.

Regresija

Regresija je proces pronalaska modela koji pomaže u razlikovanju podataka koristeći kontinuirane vrijednosti. Pri tome je naručena priroda predviđenih podataka. Neki od najčešće korištenih regresijskih modela uključuju linearnu regresiju, slučajnu šumu (stabla odluka), neuronske mreže.

Linearna regresija

- Jedan od najjednostavnijih pristupa u superviziranom učenju, koji je koristan za predviđanje kvantitativnog odgovora.

- Linearna regresija uključuje pronalaženje najbolje odgovarajuće ravne linije kroz točke. Linija koja najbolje pristaje naziva se regresijska linija. Linija najboljeg prilagođavanja ne prolazi točno kroz sve podatkovne točke, ali umjesto toga pokušava se najbolje približiti njima.

- To je široko korišteni algoritam za kontinuirane podatke. Međutim, fokusira se samo na sredinu zavisne varijable i ograničava se na linearni odnos.

- Linearna regresija može se koristiti za vremensku seriju, predviđanje trendova. Na temelju prethodnih podataka može predvidjeti buduću prodaju.

Učenje bez nadzora

- Učenje bez nadzora temelji se na pristupu koji se može smatrati odsustvom nastavnika, a samim tim i apsolutnim mjerama pogreške. Korisno je kad je potrebno naučiti grupiranje ili grupiranje elemenata. Elementi se mogu grupirati (grupirati) prema njihovoj sličnosti.

- Kod učenja bez nadzora, podaci se obilježavaju, ne kategoriziraju, a algoritmi sustava djeluju na podatke bez prethodne obuke. Algoritmi učenja bez nadzora mogu obavljati složenije zadatke od algoritama učenja pod nadzorom.

- Nenadzirano učenje uključuje klasteriranje koje se može učiniti korištenjem K znači grupiranja, hijerarhijske, Gaussove smjese, skriveni Markov model.

Aplikacije za nenadzirano učenje su:

- Otkrivanje sličnosti

- Automatsko označavanje

- Segmentacija objekta (poput osoba, životinja, filmova)

grupiranje

- Klasteriranje je nenadzirana tehnika učenja koja se koristi za analizu podataka u mnogim područjima. Algoritam klasteriranja nam je koristan kada želimo dobiti detaljni uvid u naše podatke.

- Stvarni primjer klasteriranja bili bi Netflixovi žanrovski klasteri koji su podijeljeni za različite ciljne kupce, uključujući interese, demografiju, način života itd. Sada možete razmisliti o tome koliko je korisno klasteriranje kada tvrtke žele razumjeti svoju korisničku bazu i ciljati novi potencijal kupci.

a) K znači Klasteriranje

- K znači algoritam klasteriranja pokušava podijeliti dane nepoznate podatke u klastere. Slučajno odabire 'k' centroide klastera, izračunava udaljenost između podatkovnih točaka i centroida klastera, a zatim konačno dodjeljuje podatkovnu točku centroidu klastera čija je udaljenost minimalna od svih centroida klastera.

- U k-sredinama, skupine su definirane od strane najbližeg središnjice za svaku skupinu. Ovaj centroid djeluje kao "mozak" algoritma, oni nabavljaju podatkovne točke koje su im najbliže i zatim ih dodaju u klastere.

b) Hijerarhijsko klasteriranje

Hijerarhijsko klasteriranje je gotovo slično onome uobičajenog grupiranja osim ako ne želite uspostaviti hijerarhiju klastera. Ovo vam može biti korisno kada želite odrediti broj klastera. Na primjer, pretpostavimo da stvarate grupe različitih predmeta u internetskoj trgovini. Na naslovnoj početnoj stranici želite nekoliko širokih stavki i kad kliknete na jednu od stavki, otvaraju se određene kategorije, odnosno specifičniji klasteri.

Smanjenje dimenzija

Smanjenje dimenzija može se smatrati kompresijom datoteke. Znači, vađenje informacija koje nisu relevantne. Smanjuje složenost podataka i pokušava zadržati smislene podatke. Na primjer, kompresijom slike smanjujemo dimenzionalnost prostora u kojem slika ostaje onakva kakva jest bez uništavanja previše smislenog sadržaja na slici.

PCA za vizualizaciju podataka

Analiza glavnih komponenti (PCA) metoda je smanjenja dimenzija koja može biti korisna za vizualizaciju podataka. PCA se koristi za komprimiranje podataka viših dimenzija na podatke s nižim dimenzijama, to jest, možemo koristiti PCA da smanjimo četverodimenzionalne podatke u tri ili dvije dimenzije, tako da ih možemo vizualizirati i bolje razumjeti.

Preporučeni članci

Ovo je vodič za Metode strojnog učenja. Ovdje smo razgovarali o uvodu, Kako strojevi uče? klasifikacije strojnog učenja i dijagrama tijeka zajedno s detaljnim objašnjenjem. Možete i proći naše druge predložene članke da biste saznali više -

- Arhitektura strojnog učenja

- Okviri strojnog učenja

- Alati za strojno učenje

- Tehnike strojnog učenja

- Strojno učenje hiperparametara

- Hijerarhijski algoritam klasteriranja

- Hijerarhijsko grupiranje | Aglomerativno i podjeljeno grupiranje