Pregled funkcija gubitaka u strojnom učenju

Baš kao što nas učitelji vode, bez obzira na to jesmo li dobro ili ne, to i funkcije gubitka rade isto. To je metoda procjene koliko dobro naš algoritam modelira podatke. Funkcije gubitaka glavni su izvor procjene u suvremenom strojnom učenju. Kad promijenite svoj algoritam kako biste poboljšali svoj model, vrijednost funkcije gubitka reći će vam da li napredujete ili ne. Naš bi glavni cilj trebao biti smanjenje funkcije gubitka optimizacijom. U ovom ćemo članku govoriti o tome kako funkcioniraju funkcije gubitaka i različite vrste gubitničkih funkcija.

Kako funkcioniraju funkcije gubitka?

Riječ "Gubitak" navodi kaznu zbog neuspjeha u postizanju očekivanog rezultata. Ako je odstupanje predviđene vrijednosti od očekivane vrijednosti po našem modelu veliko, tada funkcija gubitka daje veći broj kao izlaz, a ako je odstupanje malo i puno je bliže očekivanoj vrijednosti, on daje manji broj.

Evo primjera kada pokušavamo predvidjeti prodajnu cijenu kuća u metro gradovima.

| Predviđeni

Prodajna cijena (lak) | stvaran

Prodajna cijena (lak) | Odstupanje (gubitak) |

| Bangalor: 45 | 0 (sva su predviđanja tačna) | |

| Pune: 35 | ||

| Chennai: 40 | ||

| Bangalor: 40 | Bangalor: 45 | 5 lakh za Bangalore, 2 lakh za Chennai |

| Pune: 35 | Pune: 35 | |

| Chennai: 38 | Chennai: 40 | |

| Bangalor: 43 | 2 laka za Bangalor, 5 lakh za Chennai, Pune2 lakh za Chennai, | |

| Pune: 30 | ||

| Chennai: 45 |

Važno je napomenuti da količina odstupanja nije bitna, ono što je ovdje važno, je li vrijednost predviđena našim modelom ispravna ili pogrešna. Funkcije gubitka razlikuju se na osnovu vaše izjave problema na kojoj se primjenjuje strojno učenje. Funkcija troška je još jedan pojam, koji se naizmjenično koristi za funkciju gubitaka, ali ima nešto drugačije značenje. Funkcija gubitaka namijenjena je jednom primjeru treninga, dok je funkcija troškova prosječni gubitak u odnosu na cijeli skup vlakova.

Vrste funkcija gubitaka u strojnom učenju

Ispod su različite vrste gubitaka u strojnom učenju koje su sljedeće:

1) Regresijski gubitak funkcije:

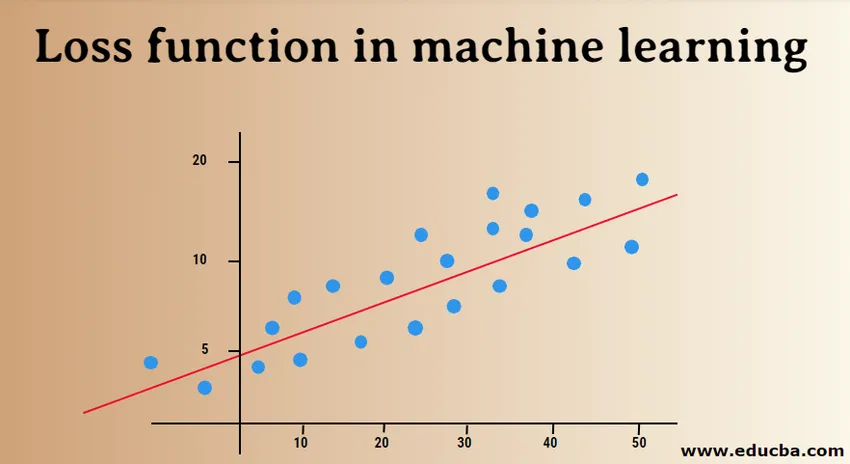

Linearna regresija temeljni je pojam ove funkcije. Funkcije regresijskog gubitka uspostavljaju linearni odnos između ovisne varijable (Y) i neovisne varijable (X), stoga nastojimo uklopiti najbolju liniju u prostoru na ove varijable.

Y = X0 + X1 + X2 + X3 + X4…. + Xn

X = nezavisne varijable

Y = zavisna varijabla

- Srednji gubitak pogreške u kvadratu:

MSE (pogreška L2) mjeri prosječnu kvadratnu razliku između stvarnih i predviđenih vrijednosti po modelu. Izlaz je pojedinačni broj povezan s skupom vrijednosti. Naš je cilj smanjiti MSE kako bi se poboljšala točnost modela.

Uzimajući u obzir linearnu jednadžbu, y = mx + c, možemo dobiti MSE kao:

MSE = 1 / N ∑i = 1 do n (y (i) - (mx (i) + b)) 2

Ovdje je N ukupni broj podatkovnih točaka, 1 / N 1i = 1 do n je srednja vrijednost, a y (i) stvarna vrijednost, a mx (i) + b njegova predviđena vrijednost.

- Srednji logaritamski gubitak pogreške (MSLE):

MSLE mjeri omjer između stvarne i predviđene vrijednosti. Uvodi asimetriju u krivulju pogreške. MSLE brine samo oko postotne razlike stvarnih i predviđenih vrijednosti. To može biti dobar izbor kao funkcija gubitka, kad želimo predvidjeti prodajne cijene kuća, prodajne cijene pekara i podaci su kontinuirani.

Ovdje se gubitak može izračunati kao srednja vrijednost promatranih podataka kvadratnih razlika između log-transformirane stvarne i predviđene vrijednosti, koja se može dati kao:

L = 1 1nnΣi (log (y (i) + 1) -log (y (i) 1)) 2

- Srednja apsolutna pogreška (MAE):

MAE izračunava zbroj apsolutnih razlika između stvarnih i predviđenih varijabli. To znači da mjeri prosječnu jačinu pogreške u skupu predviđenih vrijednosti. Korištenje srednje kvadratne pogreške lakše je riješiti, ali upotreba apsolutne pogreške robusnija je za odlaske. To su one vrijednosti koje izrazito odstupaju od ostalih promatranih podataka.

MAE se može izračunati kao:

L = 1nnΣi 1||y (i) - y (i) ||

2) Funkcije gubitka binarne klasifikacije:

Ove funkcije gubitaka izrađene su za mjerenje uspješnosti klasifikacijskog modela. Pri tome se podatkovnim točkama dodjeljuje jedna od oznaka, tj. 0 ili 1. Nadalje, mogu se klasificirati kao:

- Binarna unakrsna entropija

To je zadana funkcija gubitka za probleme binarne klasifikacije. Kros-entropijski gubitak izračunava izvedbu klasifikacijskog modela koji daje vrijednost vrijednosti vjerojatnosti između 0 i 1. Kros-entropijski gubitak raste kako predviđena vrijednost vjerojatnosti odstupa od stvarne oznake.

- Gubitak zgloba

Gubitak zgloba može se upotrijebiti kao alternativa cross-entropiji, koja je u početku razvijena za upotrebu s algoritamom vektorskih strojeva za podršku. Gubitak zgloba najbolje uspijeva kod problema s klasifikacijom jer su ciljne vrijednosti u setu od (-1, 1). Omogućuje dodijeliti više pogreške kada postoji razlika u znaku između stvarnih i predviđenih vrijednosti. To rezultira boljim performansama od unakrsne entropije.

- Gubitak zgloba u kvadratu

Proširenje gubitka šarke, koji se jednostavno izračunava kvadratom gubitka šarke. Smanjuje funkciju pogreške i čini je brojčano lakšom za rad. Nalazi granicu klasifikacije koja određuje maksimalnu maržu između podatkovnih točaka različitih klasa. Gubitak šarki u kvadratu savršeno odgovara DA ili NE problemima s odlukom, pri čemu odstupanje vjerojatnosti nije najvažnije.

3) Funkcije gubitka klasifikacije za više klasa:

Klasifikacija u više klasa su prediktivni modeli u kojima su podatkovne točke dodijeljene više od dvije klase. Svaka klasa dodjeljuje jedinstvenu vrijednost od 0 do (Broj_of_klasa - 1). Toplo se preporučuje zbog problema s klasifikacijom slika ili teksta, gdje pojedinačni rad može imati više tema.

- Višeklasna unakrsna entropija

U ovom slučaju, ciljne vrijednosti su u skupu od 0 do n, odnosno (0, 1, 2, 3 … n). Izračunava rezultat koji uzima prosječnu razliku između stvarnih i predviđenih vrijednosti vjerojatnosti, a rezultat se minimizira kako bi se postigla najbolja moguća točnost. Višeklasna unakrsna entropija je zadana funkcija gubitka problema s klasifikacijom teksta.

- Rijetka križna entropija u više klase

Jedan vrući postupak kodiranja otežava multi-klasu cross-entropije tešku obradu velikog broja podataka. Rijetka unakrsna entropija rješava ovaj problem vršeći izračun pogreške bez upotrebe jedno-vrućeg kodiranja.

- Kullback Leibler gubitak od divergencije

KL gubitak divergencije izračunava divergenciju između distribucije vjerojatnosti i raspodjele polaznih točaka i otkriva koliko je podataka izgubljeno u smislu bita. Izlaz je negativna vrijednost koja određuje koliko su blizu dvije distribucije vjerojatnosti. Da bi se opisala odstupanja od KL-a u smislu vjerojatnosti, koristi se omjer vjerojatnosti.

U ovom smo članku na početku shvatili kako funkcioniraju funkcije gubitaka, a zatim smo nastavili s opsežnim popisom funkcija gubitaka pomoću primjera korištenih slučajeva. Međutim, razumijevanje toga praktički je korisnije, zato pokušajte pročitati više i primijeniti ga. Temeljito će razjasniti vaše sumnje.

Preporučeni članci

Ovo je vodič za gubitke u strojnom učenju. Ovdje smo raspravljali o tome kako funkcioniraju funkcije gubitka i vrste gubitnih funkcija u strojnom učenju. Možete također pogledati sljedeće članke da biste saznali više -

- Metode strojnog učenja

- Uvod u strojno učenje

- Tehnologije velikih podataka

- Softver za velike podatke analitike

- Naučite katogije hiperparametara

- Životni ciklus strojnog učenja | Top 8 pozornica